Use a IA para avaliar a qualidade da imagem do jogo! A Intel lança uma nova ferramenta de avaliação CGVQM

A Intel abriu recentemente a ferramenta de avaliação de qualidade de vídeo baseada em IA CGVQM (Indicadores de qualidade visual da Computer Graphics) no GitHub, com o objetivo de fornecer padrões quantitativos objetivos para jogos e renderização em tempo real das imagens. A ferramenta é publicada em forma de Pytorch, e os documentos de pesquisa de apoio são lançados simultaneamente.

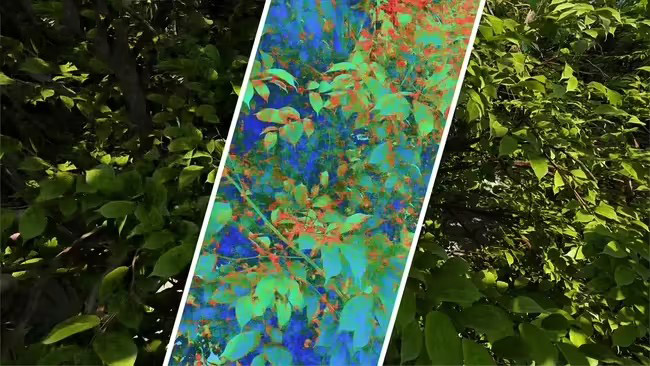

Os jogos atuais geralmente dependem de tecnologias de super pontuação, como o DLSS, para melhorar o desempenho, mas são propensas a causar problemas visuais, como fantasmas e tremores. Indicadores tradicionais de qualidade de imagem (como PSNR) avaliam apenas artefatos de compressão e não podem refletir completamente a distorção complexa da renderização em tempo real. Para esse fim, a equipe da Intel construiu um conjunto de dados CGVQD, abrangendo a degradação diversificada da qualidade da imagem causada por tecnologias como rastreamento de caminhos e hiperesses neurais e treinou o modelo CGVQM com base nesse conjunto de dados. Este modelo adota uma rede neural convolucional 3D (arquitetura 3D-RESNET-18), que pode capturar simultaneamente recursos de imagem em dimensões espaciais e identificar com mais precisão problemas de qualidade de imagem.

Os experimentos mostram que o efeito de avaliação do CGVQM excede de forma abrangente as ferramentas existentes: a versão complexa do CGVQM-5 está próxima da linha de base da pontuação humana, e a versão simplificada do CGVQM-2 também está firmemente entre os três primeiros e mostrou boa capacidade de generalização em vídeos não treinos. No futuro, o desempenho do modelo pode ser otimizado ainda mais, introduzindo informações sobre transformador ou fluxo óptico.